在数据治理的宏大框架中,数据质量管理是确保数据价值得以有效释放的核心环节。尤其在大数据时代,数据量的爆炸性增长、来源的多元化以及应用场景的复杂化,使得数据质量管理不仅是一项技术任务,更是一项贯穿数据全生命周期的战略性工作。它直接关系到大数据服务的可信度、决策的准确性以及最终的业务成效。

一、数据质量管理的核心内涵

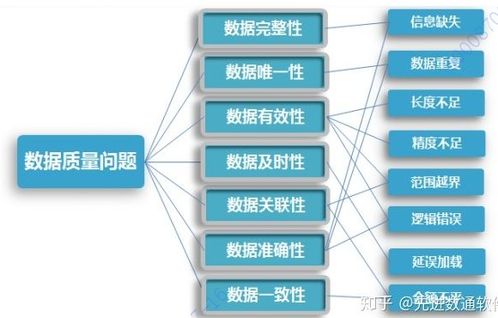

数据质量管理旨在通过一系列的策略、技术和流程,确保数据在准确性、完整性、一致性、及时性和可靠性等方面满足既定标准。它不仅仅是发现和修正错误,更是一种预防性的文化,要求在数据产生的源头、流转的中间环节以及最终使用的终端都建立起质量控制的屏障。

二、大数据服务对数据质量管理提出的新挑战

- 体量巨大,处理复杂:传统的数据清洗和验证工具在面对TB甚至PB级的数据时,可能力不从心。如何在可接受的时间和资源成本内完成海量数据的质量评估与修复,是首要挑战。

- 多样性突出,标准难统一:大数据来源广泛,包括结构化数据、半结构化数据和非结构化数据(如文本、图像、日志)。不同来源的数据格式、标准、定义千差万别,建立统一的质量衡量标准和整合规则异常困难。

- 速度要求高,实时性增强:流式数据处理场景日益增多,如实时监控、风险预警等。这要求数据质量管理必须具备近实时或实时的检测与响应能力,对延迟的容忍度极低。

- 价值密度低,相关性管理重要:海量数据中蕴含高价值的信息比例可能很低。质量管理需要能够智能识别哪些数据、哪些质量问题对特定业务场景是关键的,而非对全部数据“一视同仁”地进行成本高昂的清洗。

三、构建面向大数据服务的质量管理体系

为应对上述挑战,需要构建一个多层、自动化、智能化且与业务流程深度融合的数据质量管理体系:

- 制定分级的质量标准:根据数据的关键性、使用场景(如用于战略决策、运营分析还是日常查询)制定差异化的质量指标和容忍阈值。对于核心数据资产,执行最严格的标准。

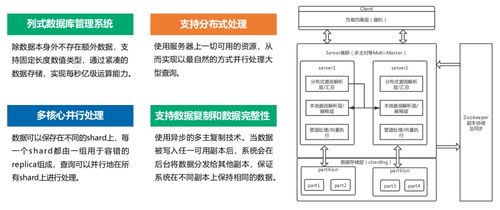

- 实施全链路质量监控:将质量检查点嵌入数据从采集、传输、存储、处理到服务提供的每一个环节。利用大数据处理框架(如Spark、Flink)本身的能力,实现分布式的、可扩展的质量规则执行。

- 强化源头治理与元数据管理:尽可能在数据入口处进行标准化和验证。建立强大的元数据管理体系,清晰记录数据的血缘关系、转换过程和质量属性,为问题追溯和影响分析提供支持。

- 拥抱自动化与智能化工具:采用数据质量剖析、异常检测、模式识别等工具自动发现质量问题。结合机器学习和人工智能技术,实现质量规则的自动学习与优化,以及对潜在质量风险的预测。

- 建立闭环管理流程与文化:明确数据质量问题的发现、上报、分派、修复、验证和关闭流程。将数据质量指标纳入部门及个人的绩效考核,在全组织范围内培育“数据质量人人有责”的文化。

四、数据质量管理赋能大数据服务

高质量的数据是大数据服务创造价值的基石。有效的数据质量管理能够:

- 提升服务可信度:确保数据分析结果、推荐模型、API接口返回数据的可靠性,赢得内外部用户的信任。

- 降低运营风险与成本:减少因数据错误导致的决策失误、合规风险和无效的IT资源消耗。

- 加速数据价值变现:干净、可信的数据缩短了从数据准备到分析洞察的周期,使业务部门能更快地利用数据驱动创新。

- 保障数据资产长效增值:将数据作为核心资产进行持续的质量维护,是其保值增值的前提。

###

在大数据服务的广阔图景中,数据质量管理已从后台支持角色走向前台,成为决定服务成败的关键竞争力。它是一个持续的过程,而非一劳永逸的项目。面对不断演进的技术和业务需求,组织必须以战略眼光、体系化方法和创新技术来持续投资和优化数据质量管理能力,从而确保其大数据服务行稳致远,真正释放数据要素的巨大潜能。